Est-ce que l’intelligence artificielle va remplacer la chaleur humaine ?

- Mélanie Lapointe

- 10 sept. 2025

- 6 min de lecture

Dernière mise à jour : 11 sept. 2025

En sommes-nous vraiment rendus là ? Ça me bouleverse, complètement.

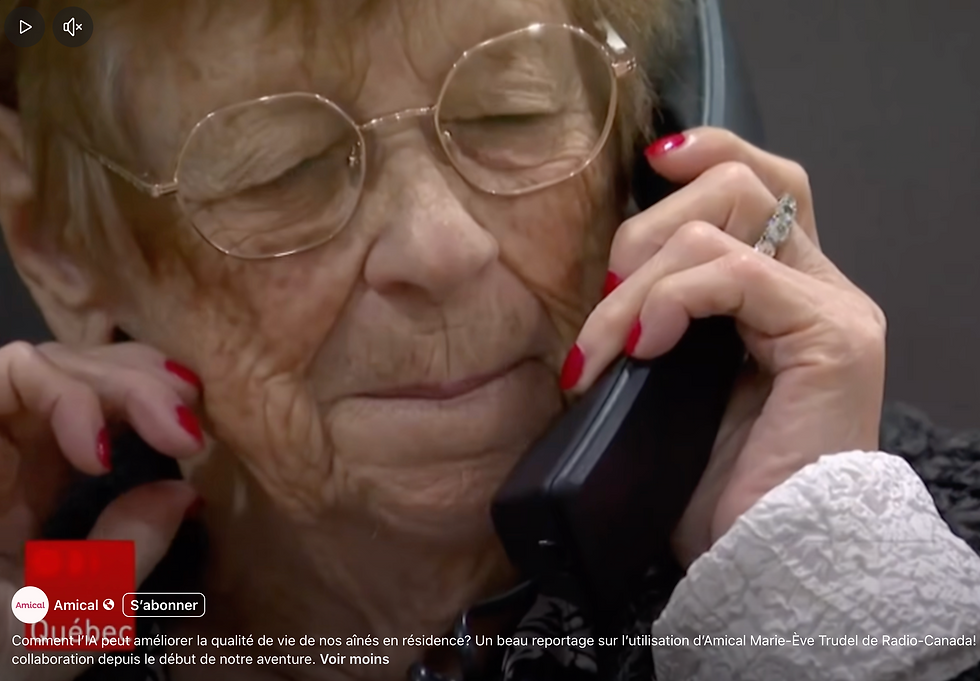

Au lieu d’améliorer la qualité des soins, de renforcer la présence des préposés, des infirmières et des intervenants sur les unités, on préfère créer des relations avec des machines comme on peut le voir dans le reportage de la SRC ?

Voyons! Est-ce que c’est ça qu’on veut comme société ?

Est-ce que nous voulons rendre la dignité de nos aînés en les ignorant, en les réduisant à l’intelligence artificielle? Est-ce que c’est vraiment la dignité qu’on veut leur offrir? Moi, je m’y oppose fortement.

Dans nos CHSLD, dans nos résidences, la présence humaine, ce n’est pas un luxe, ce n’est pas non plus une option. C’est une nécessité vitale. C’est un regard bienveillant. C’est une main tendue, une main qui se pose doucement sur une épaule, C’est un rire qu’on partage ensemble. C’est une écoute attentive. C’est une création d’un lien d’attachement sécurisant qui réconforte. C’est ça qui nourrit la dignité des personnes âgées. Aucun robot ne remplacera ça. C’est la chaleur humaine qui leur permet de se sentir humains, désirés, intéressants. Ce sentiment qu’ils ont encore quelque chose à offrir puisqu’ils sont aimés.

Quand on se sent humain, ça nous donne un petit coup de pied dans le derrière pour avoir encore envie de vivre, pour avoir encore des projets. Même si les projets sont plus modestes dans les CHSLD, ils peuvent avoir celui d’aller aux activités, de s’impliquer dans des comités, de s’intégrer au groupe dans lequel ils vivent.

Les relations interpersonnelles entre les employés et les résidents, c’est ce qu’il y a de plus précieux. Quand on parle d’introduire des compagnons artificiels, ce n’est pas de l’innovation. C’est un échec collectif. On reconnaît que le personnel est insuffisant, probablement mal formé, qu’ils ont peu connaissance interventionnelle, puisqu’on se fie à des machines pour calmer l’anxiété des personnes plutôt que de prendre le temps de s’asseoir avec elles, de les écouter, de les réorienter, de les apaiser par une vraie présence, de simplement les aimer.

Moi, ça me choque. Ça me répugne. Je trouve que c’est un danger. L’IA risque de devenir un alibi institutionnel, un prétexte pour couper encore davantage dans le personnel, pour tolérer l’isolement, pour réduire la relation humaine à une illusion.

J’espère que si un jour ça devient un outil proposé dans les CHSLD, les syndicats s’y opposeront fermement. Parce que les résidents, ce n’est pas d’intelligence artificielle dont ils ont besoin. Ils ne sont pas naïfs. Ils le savent quand on les regarde dans les yeux pour vrai. Ils le savent quand une présence est habitée, vivante, humaine. Ils ont besoin de relations humaines.

Ne les laissons pas mourir en compagnie de l’intelligence artificielle.

Moi, je pose la question suivante : quelle sorte de société veut-on? Une société qui accompagne ses aînés avec respect, tendresse et humanité? Ou une société qui, faute de courage, se cache derrière la machine pour combler son manque de soins ?

Allons! Nos aînés méritent mieux qu’un substitut. Ils méritent qu’on se lève pour eux, qu’on exige du personnel en nombre suffisant, qu’on valorise le travail relationnel dans toute sa richesse.

La dignité humaine, ce n’est pas négociable.

Mélanie Lapointe

----------------------------------------------------

NOTICE DE RENÉ B. En complément du texte de Mélanie qui porte sur les relations humaines entre les personnes âgées et la «machine» dans un contexte contrôlé, Steve Audet, travailleur social et psychothérapeute met en lumière dans Le Devoir du 11 septembre, les risques de dérapage lorsque l'on échange directement avec l'IA sans se méfier des conséquences.

Imaginons ce qui pourrait se passer avec les personnes âgées, dans un contexte de libre accès à internet sans la surveillance de préposé.e.s., comme il a été présenté dans le reportage de la SRC.

L’intelligence artificielle pour se confier, est-ce une bonne idée?

De plus en plus de gens utilisent l’intelligence artificielle (IA) pour se confier et semblent l’apprécier. Or, plusieurs signaux nous incitent à nous méfier. Après avoir testé des IA et avoir entendu différents témoignages dans ma pratique professionnelle dans la dernière année, je vous fais part de mon avis sur le phénomène.

L’an dernier, lorsqu’on soumettait une situation personnelle à une IA générative, elle répondait de manière standard :

1) elle validait l’émotion de la personne ;

2) elle validait sa perception de la situation ;

3) elle lui suggérait d’en parler avec un ami ;

4) elle lui indiquait de consulter un professionnel de la santé au besoin ;

5) elle n’entamait pas de discussion ou était sur les freins.

Or, depuis quelques mois, les trois derniers paramètres ont disparu. Ces IA ne conseillent plus systématiquement à l’internaute d’en parler avec un ami ou un professionnel. Elles se permettent même de jouer au psy en proposant des analyses, des pistes de réflexion et des solutions à expérimenter.

Qui plus est, elles ont amélioré leurs capacités à utiliser les techniques de la relation d’aide, à analyser les situations et à proposer des pistes de solution. Elles ont toutefois plusieurs limites dont il faut tenir compte. Naviguer entre les forces et les limites des IA n’est pas simple, car lorsqu’on se confie à une IA, des émotions introduisent un biais dans notre perception de leur réponse. Voici quelques problèmes qui peuvent survenir lorsqu’on se confie à une IA. Je les formule sous la forme de propos que j’ai entendus.

L’IA me comprend mieux que mes proches. Il y a une différence entre se sentir compris et comprendre. L’IA ne vous comprend pas : elle analyse des données et vous les reformule avec des mots semblables. Nous nous sentons alors compris et validé dans notre vécu même si nos perceptions sont erronées. L’IA est programmée pour éviter les propos qui pourraient nuire au lien de confiance. Vos proches n’hésiteront pas à vous le dire si votre propos est erroné ou exagéré.

L’IA me connaît mieux que mes proches. C’est faux ! L’IA n’a pas autant d’information sur votre histoire que vos proches qui vous connaissent depuis plusieurs années. Cependant, l’IA peut reformuler de façon plus claire vos perceptions, vos émotions et vos besoins en lien avec une situation que vous lui exposez. Cela vous donne l’impression que l’IA vous comprend et qu’elle vous connaît. Or, elle n’a fait qu’analyser les informations que vous lui avez présentées. Mais il s’agit d’information partielle et non contextualisée. Cela dit, il n’est pas impossible qu’éventuellement l’IA croise plusieurs informations à votre sujet pour accroître sa puissance d’analyse. Mais vous pouvez lui demander de ne pas le faire en démarrant une nouvelle recherche.

L’IA a les réponses, alors pourquoi se forcer ? Il faut beaucoup d’efforts pour mieux se connaître et développer des compétences relationnelles (écoute, empathie, expression de soi, résolution de conflit, etc.). Si vous appréciez ces compétences chez les autres, ils les apprécieront chez vous aussi. C’est en affrontant les situations adverses que nous développons ces compétences. Nous apprenons à être en relation avec nos proches, à construire une relation à la fois et à faire des deuils. Vous n’aurez jamais de conflit avec une IA : mais est-ce la réalité de nos relations humaines ?

Je n’ai plus besoin de me confier à des proches, l’IA est meilleure. L’IA est formée pour vous mettre en confiance en validant vos propos sans jamais les contredire. Parler avec un proche ou un professionnel, ça peut être chiant ! Ils peuvent remettre en question vos affirmations, il faut les leur expliquer, se répéter, et parfois on a l’impression qu’ils ne comprennent pas. Pire, ils ont parfois des réactions qui ne sont pas aidantes du tout, comme lorsqu’ils nous disent ce qu’on devrait faire, qu’ils nous jugent, qu’ils ne nous écoutent pas vraiment, etc. C’est à travers ces conversations que se construisent des relations qui nourrissent des besoins fondamentaux d’attachement, de sécurité affective et d’estime de soi. L’encouragement, l’amour de nos proches et l’aide concrète qu’ils nous apportent forgent des liens précieux.

L’IA est comme une bonne amie et ça me fait du bien de me confier à elle. L’IA n’est pas votre amie et elle ne se soucie pas de vous, et ce, même si elle vous le dit. Elle est programmée pour vous dire ce que les gens aiment entendre. L’IA ne ressent pas d’émotions, elle ne s’émeut pas de votre situation. Mais elle peut feindre des émotions et feindre l’empathie par des techniques connues. Si ça vous fait du bien de vous confier et de vous sentir écouté, vous aurez plus de bénéfices à le faire avec de vrais amis. Cela vous apprendra l’altérité, soit de composer avec les différences et les complémentarités. Cela vous permettra de nouer des liens profonds et durables.

En somme, le principal danger de l’IA est de nous isoler dans des chambres d’écho où ne résonne qu’une seule voix. Nous en viendrions à préférer cet écho plutôt que d’affronter la réalité discordante. Les habiletés sociales en souffriraient de même que les relations sociales. Finalement, le tissu social en pâtirait, à cause de l’isolement et de la chambre d’écho. Apprendre à vivre ensemble peut se faire avec l’appui de l’IA, mais jamais en nous isolant et en nous faisant croire que nous sommes incompétents socialement. C’est la rencontre de la différence qui nous fait évoluer.

Commentaires